Chapter 5. The Madaline

Dimana wo adalah bias pada prosedur percobaan. elmen non linear, di sini elemen threshold sederhana, untuk menghasilkan Adaline keluaran y sebagai :

y = sign (z)

Gambar 3.3 Activation function nonlinearity (Signum function).

Jaringan saraf tiruan memiliki beberapa bagian yaitu

1. Bagian input.

Bagian input merupakan bagian awal dari jaringan saraf tiruan. Input yang akan dideteksi dibagi menjadi bagian - bagian kecil. Contohnya adalah pembagian menjadi pixel pada gambar. Kemudian tiap piksel akan dianalisis dan belanjut ke layer berikutnya

2. Bagian tersembunyi

Bagian Tersembunyi atau hidden layer merupakan bagian dari JST yang berfungsi untuk membantu pengelompokkan atau klasifikasi data.

3. Bagian output.

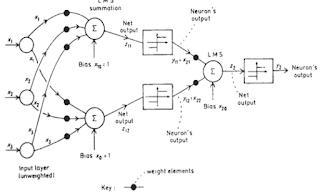

Madaline (Many Adaline) adalah ekstensi multilayer dari single-neuron bipolar Adaline ke suatu jaringan. Struktur dasar dari Madaline ini dapat dilihat pada gambar 5.1, dan gambar 5.2 memperlihatkan Madaline yang terdiri dari dua layers Adaline, ditambah sebuah layers input yang hanya berfungsi sebagai distributor input jaringan.Bagian Tersembunyi atau hidden layer merupakan bagian dari JST yang berfungsi untuk membantu pengelompokkan atau klasifikasi data.

3. Bagian output.

Gambar 5.1 A simple Madaline structure

Gambar 5.2 The Madaline network of 2 layers

5.1 Madaline Training <kembali>

Dalam Madaline terdapat sebuah layer tersembunyi. Gambar 5.3 menunjukkan arsitektur Madaline untuk 2 buah masukan x1 dan x2, sebuah layer tersembunyi yang terdiri dari 2 unit neuron tersembunyi z1 dan z2, dan sebuah keluaran Y.

Gambar 5.3

Keluaran dari unit tersembunyi z1 dan z2 adalah nilai fungsi aktivasi yang diterima dari x1 dan x2. Demikian pula unit keluaran Y merupakan nilai fungsi aktivasi dari z1 dan z2. Meskipun keluaran z1 dan z2 masing-masing merupakan fungsi linier, tetapi keluaran Y bukanlah fungsi linier x1 dan x2 karena adanya unit tersembunyi.

Algoritma pelatihan Madaline II adalah sebagai berikut:

1. Inisialisasi bobot

· v1=1/2, v2=1/2, b3=1/2

· bobot yang lain menggunakan bilangan random yang kecil

· nilai learning rate ditentukan antara 0,1 ≤ na ≤ 1.0

2. Untuk setiap bipolar input pada vektor x

· Set aktivasi dari input unit ke x

· Hitung masukan jaringan ke setiap hidden unit

Zin1 = b1 + x1w11 + x2w21

Zin2 = b2 + x1w12 + x2w21

· Tentukan output dari setiap hidden unit

Z1 = f(Zini)

Z2 = f(Zini)

3. Untuk setiap bipolar input pada vektor x

· Tentukan keluaran dari jaringan

Yin = b3 + z1v1 +z2v2

Y = f(Yin)

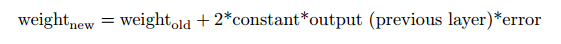

· Hitung error dan update bobot, jika t≠y maka laukan update bobot untuk setiap hidden unit dengan input mendekati 0

- Ubah keluaran unit (dari +1 menjadi –1, atau sebaliknya)

- Hitung kembali respon dari jaringan. Jika kesalahan berkurang: Sesuaikan bobot pada unit ini (gunakan nilai keluaran yang baru sebagai target dan lakukan aturan Delta)

bj (new) = bj (old) + ∝ (1 – zinj)

wij (new) = wij (old) + ∝ (1 – zinj) xi

bk (new) = bk (old) + ∝ (-1 – zink)

wik (new) = wik (old) + ∝ (-1 – zink) xi

wij (new) = wij (old) + ∝ (1 – zinj) xi

bk (new) = bk (old) + ∝ (-1 – zink)

wik (new) = wik (old) + ∝ (-1 – zink) xi

5.2 Madeleine Studi Kasus (Character Recognition)<kembali>

- Problem statement

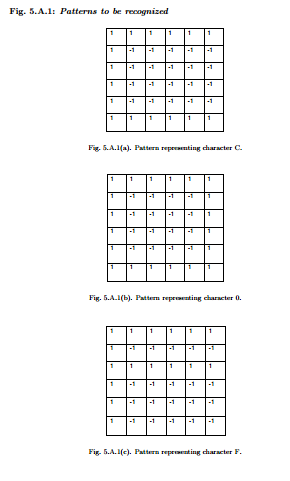

Merancang Madaline (Multiple Adaline) Neural Network untuk mengenali 3 karakter 0, C dan F disediakan dalam format biner dan mewakili menggunakan 6 × 6 kotak. Neural Network harus dilatih dan diuji dengan berbagai pola, total tingkat kesalahan dan jumlah konvergensi harus diamati. pola khusus yang digunakan untuk pelatihan dan pengujian adalah sebagai pada Gambar. 5.A.1.

2. Design of network

2. Design of network

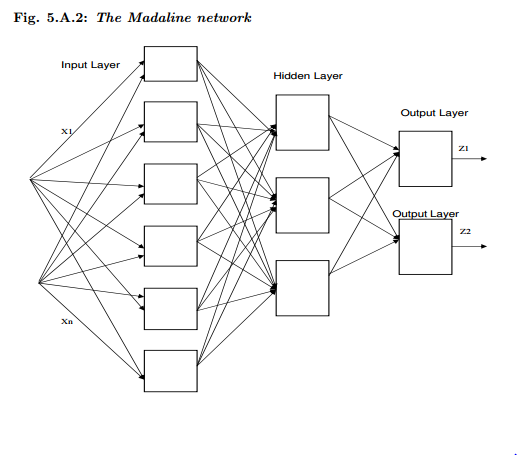

Sebuah jaringan Madaline seperti pada Gambar. 5.A.2 dirancang dengan 3 lapisan, masukan (6neuron), tersembunyi (3 neuron), dan output (2 neuron), lapisan. 36 masukan dari grid mengandung karakter 0, C atau F diberikan sebagai masukan ke jaringan. 15 input set diberikan, 5 masing-masing selama 3 dan 0 itu. Bobot jaringan yang awalnya ditetapkan di secara acak dalam kisaran {-1, 1}.

3. Training of the network

Berikut ini adalah langkah-langkah dasar untuk Pelatihan dari Jaringan Neural Back Propagation :

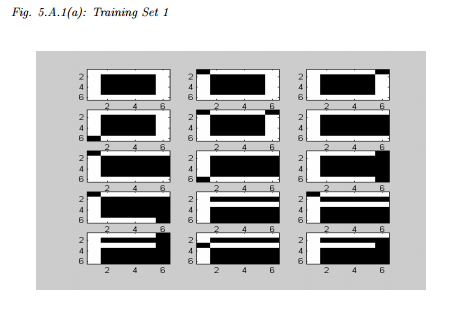

- Gunakan data training set dengan 5 set 0 , C dan F masing-masing.

- Umpan set pelatihan ini (lihat Gambar. 5.A.3) ke jaringan.

- Set bobot jaringan secara acak di kisaran {-1, 1}.

- Gunakan hardlimiter fungsi transfer untuk setiap neuron.

- Setiap output lulus sebagai masukan ke lapisan berturut-turut.

- Output akhir dibandingkan dengan output yang diinginkan dan kesalahan kumulatif untuk 15 input dihitung.

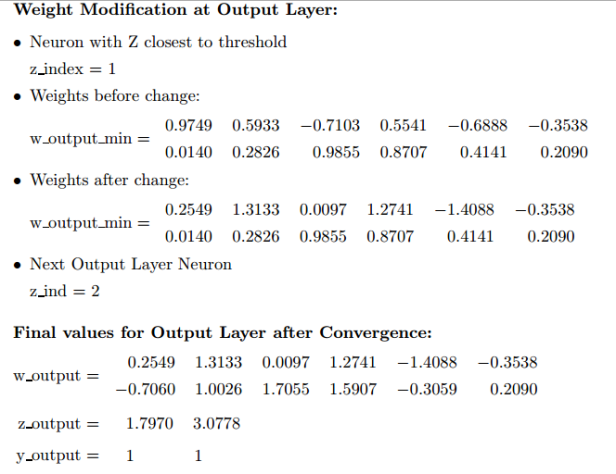

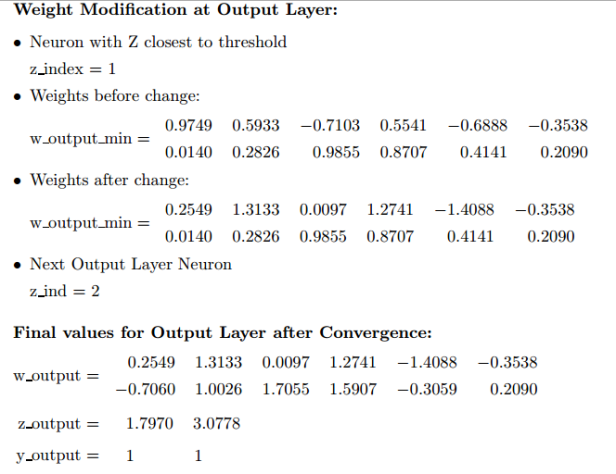

- Jika kesalahan persen di atas 15% (untuk neuron yang memiliki output terdekat 0) maka bobot dari lapisan output berubah menggunakan :

- Berat diperbarui untuk berbagai neuron sampai tidak ada kesalahan atau kesalahan adalah dibawah ambang batas yang diinginkan.

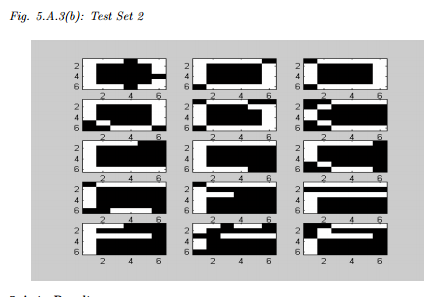

- Uji kumpulan data diumpankan ke jaringan dengan bobot diperbarui dan output (error) diperoleh dengan demikian menentukan efisiensi jaringan.

4. The Training Sets:

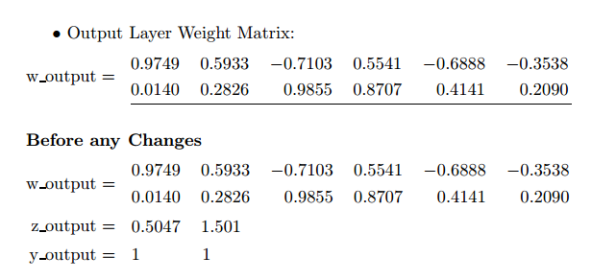

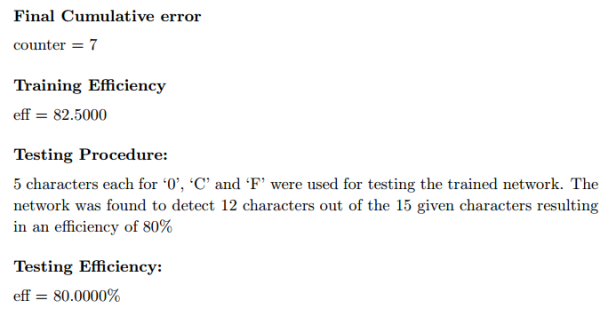

5. Hasil

Hasilnya seperti berikut:

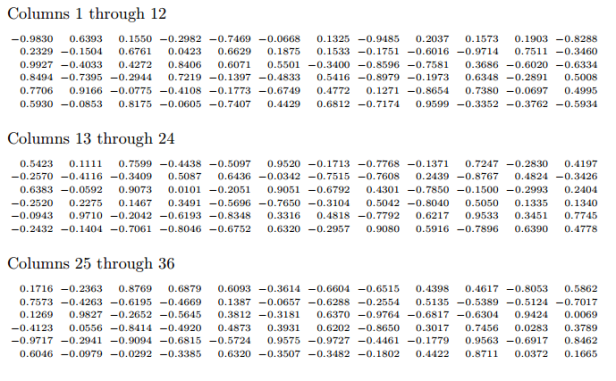

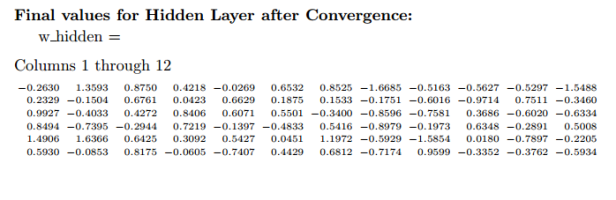

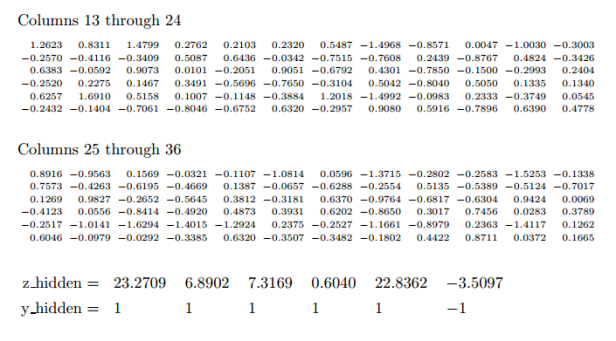

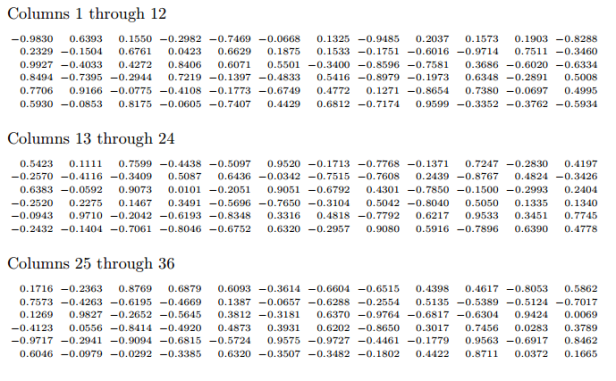

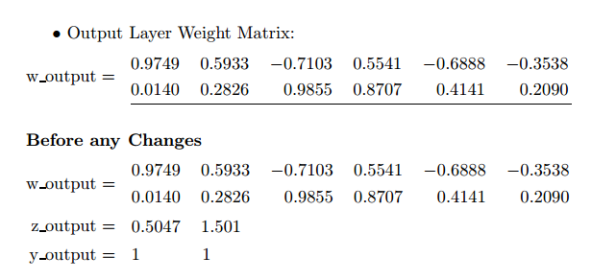

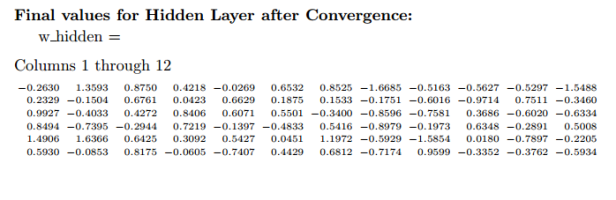

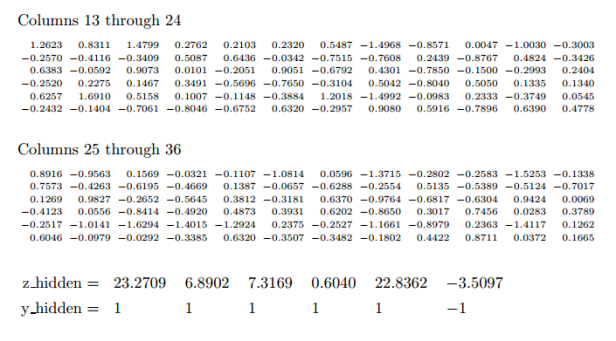

• Lapisan Tersembunyi Bobot Matrix:

w hidden =

• Lapisan Tersembunyi Bobot Matrix:

w hidden =

6. Kesimpulan

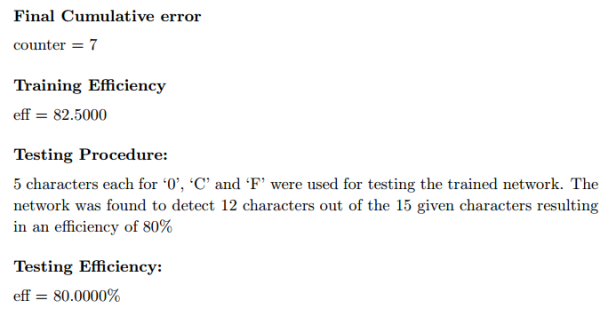

• The Neural Network dilatih dan diuji untuk pengujian dan pelatihan pola yang berbeda. Dalam semua kasus jumlah konvergensi dan error tingkat diamati.

• Konvergensi sangat bergantung pada lapisan tersembunyi dan jumlah neuron di setiap lapisan tersembunyi.

• Jumlah di setiap lapisan tersembunyi harus tidak terlalu kurang atau terlalu tinggi.

• Jaringan Syaraf terlatih sangat akurat dalam mengklasifikasikan data yang di sebagian besar kasus uji. Jumlah kesalahan yang diamati adalah 6% (approx.), Yang sangat ideal untuk masalah klasifikasi seperti Face Detection.

Komentar

Posting Komentar